Aggiornamenti recenti Maggio 11th, 2026 3:00 PM

News Recenti

- Transparency Center Initiative di Kaspersky Lab: cosa significa per l’Italia

- Falso repository OpenAI su Hugging Face distribuisce malware

- Ecco il GitHub per fare di Claude un operatore OSINT avanzato

- Un dipendente su otto considera accettabile vendere le credenziali

- Quasar Linux RAT: malware che punta alla supply chain software

- CISA avvisa: Copy Fail sfruttata per root sui sistemi Linux

Prompt injection indiretta, Google migliora la sua strategia di sicurezza a più livelli per l’IA

Giu 24, 2025 Marina Londei Hacking, In evidenza, Minacce, News, RSS, Tecnologia 0

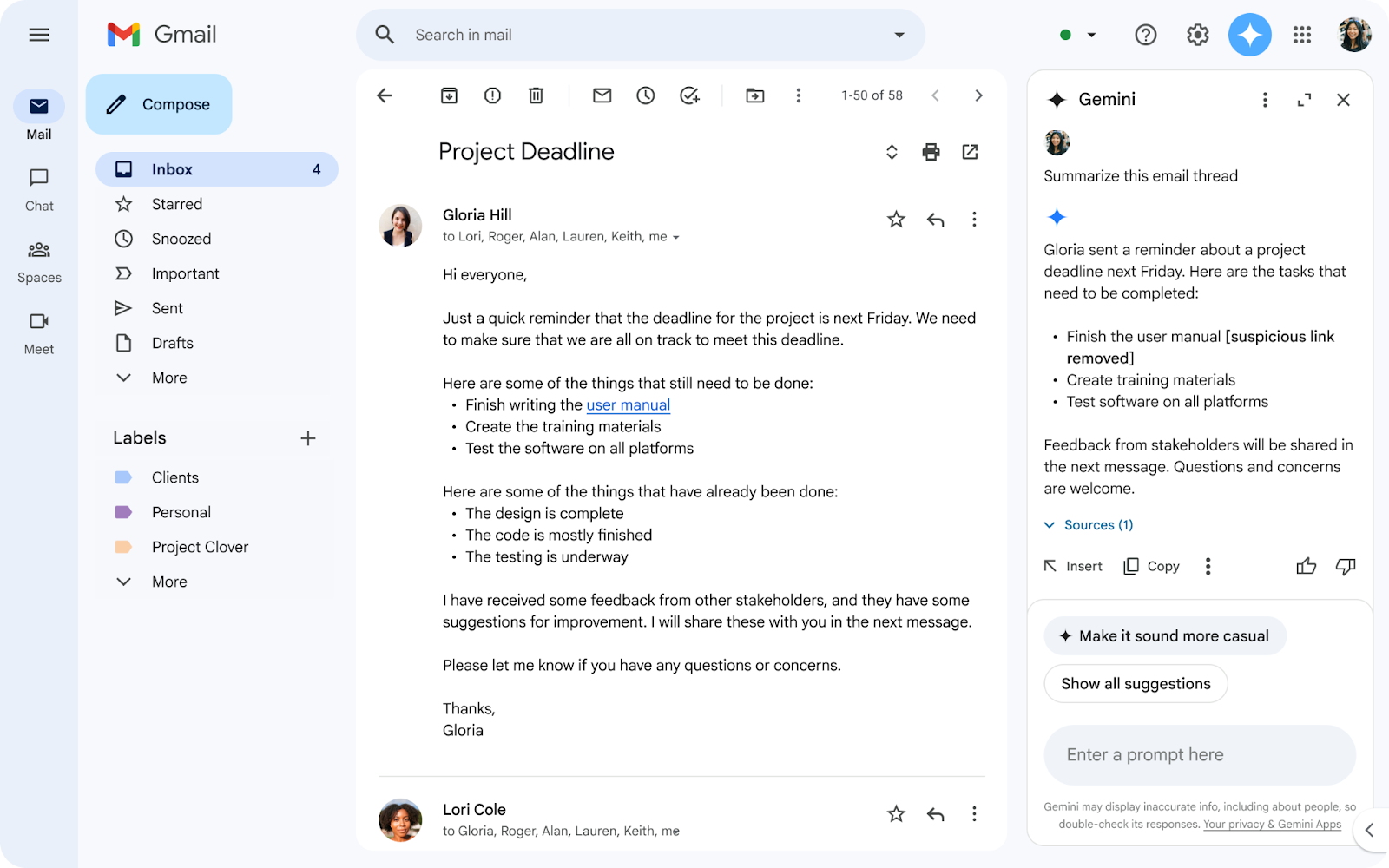

Tra le minacce più preoccupanti per i sistemi di intelligenza artificiale c’è la prompt injection indiretta, una tecnica che, a differenza di quella diretta, nasconde istruzioni malevole in sorgenti esterne, come inviti a riunioni, email o documenti. Per proteggersi da questa modalità di prompt injection, Google sta integrando nuove misure di sicurezza a più livelli nei propri strumenti.

La strategia “stratificata” del gigante tech prevede misure di sicurezza a ogni livello del ciclo di vita del prompt per rendere più difficile il lavoro dell’attaccante, in modo che “siano costretti ad affidarsi a metodi più facili da individuare o che richiedono più risorse” afferma il team GenAI Security di Google.

La difesa di Google contro l’iniezione indiretta di comandi comincia proprio dal prompt: la compagnia sta rilasciando dei modelli di machine learning in grado di individuare prompt e istruzioni malevole in diverse forme, comprese email e file. “Quando gli utenti cercano dati su Workspace con Gemini, i classificatori di contenuti filtrano i dati pericolosi che contengono istruzioni malevole” continua il team di sicurezza della compagnia.

Il secondo livello di protezione prevede un ulteriore controllo sul prompt che obbliga l’LLM a eseguire esclusivamente l’istruzione richiesta dall’utente, ignorando qualsiasi altra istruzione che potrebbe essere presente nel contenuto da caricare.

Il terzo livello di protezione agisce sugli URL delle immagini esterne, impedendo all’LLM di renderizzarle, e segnala qualsiasi URL sospetto senza includerlo nella risposta.

Credits: Google

Dal prossimo futuro Gemini richiederà, come ulteriore misura di protezione, un sistema di conferma utente per eseguire determinate azioni; “Per esempio, operazioni potenzialmente rischiose come cancellare un evento dal calendario scatenerebbe una richiesta di conferma per l’utente, aiutando così a prevenire l’esecuzione immediata e nascosta dell’operazione” chiarisce Google.

Infine, come ultima misura di sicurezza contro la prompt injection indiretta, Gemini notificherà all’utente l’eventuale presenza di allegati e contenuti malevoli, cancellando la risposta generata.

“La nostra strategia di sicurezza completa contro la prompt injection rafforza l’intero framework di sicurezza per Gemini“ afferma il team di Google. Oltre alle tecniche integrate nell’LLM, la compagnia ha annunciato nuovi test manuali e automatici di red teaming, l’uso di robusti standard di sicurezza come il Secure AI Framework (SAIF) e nuove partnership sia con ricercatori tramite il programma VRP (Vulnerability Reward Program) che con altre aziende tech grazie alla Coalition for Secure AI (CoSAI).

Articoli correlati

-

AWS Bedrock: otto vettori che...

AWS Bedrock: otto vettori che...Mar 23, 2026 0

-

Sandworm_Mode: il “worm” della...

Sandworm_Mode: il “worm” della...Feb 24, 2026 0

-

False estensioni AI su Chrome: rubano...

False estensioni AI su Chrome: rubano...Feb 13, 2026 0

-

OpenSSL ha fixato 12 vulnerabilità...

OpenSSL ha fixato 12 vulnerabilità...Gen 29, 2026 0

Altro in questa categoria

-

Falso repository OpenAI su Hugging Face...

Falso repository OpenAI su Hugging Face...Mag 11, 2026 0

-

Ecco il GitHub per fare di Claude un...

Ecco il GitHub per fare di Claude un...Mag 08, 2026 0

-

Un dipendente su otto considera...

Un dipendente su otto considera...Mag 07, 2026 0

-

Quasar Linux RAT: malware che punta...

Quasar Linux RAT: malware che punta...Mag 06, 2026 0

Last Week Security IT

Malware distruttivi ancora in auge

Approfondimenti

-

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Honeypot intelligenti: come gli agenti AI ingannano gli...

Honeypot intelligenti: come gli agenti AI ingannano gli...Apr 29, 2026 0

Stanno arrivando, ma non nascono già pronti. Stiamo... -

I dati sono recuperabili (troppo) facilmente dalle auto...

I dati sono recuperabili (troppo) facilmente dalle auto...Apr 28, 2026 0

Come sappiamo, le auto moderne sono sempre più simili a... -

Reset password: una misura di sicurezza che diventa

Reset password: una misura di sicurezza che diventaApr 23, 2026 0

Vi ricordate il vecchio adagio “cambia la password almeno... -

Recovery scam: quando la truffa colpisce due volte

Recovery scam: quando la truffa colpisce due volteApr 16, 2026 0

Nel panorama delle minacce informatiche, esiste una...

Minacce recenti

Google API Keys: le chiavi pubbliche diventano credenziali sensibili

Lummastealer risorge dalle ceneri: ancora una volta lo stop è momentaneo

ZeroDayRAT: La Nuova Minaccia per Android e iOS

Off topic

-

L’IA generativa unifica le interfacce di gestione e...

L’IA generativa unifica le interfacce di gestione e...Gen 29, 2025 0

Con l’avvento dell’IA generativa... -

Cyberinsurance: misurare il rischio umano può...

Cyberinsurance: misurare il rischio umano può...Ott 09, 2024 0

Negli ultimi anni sempre più aziende stanno sottoscrivendo... -

Il machine learning di Kaspersky aumenta la capacità di...

Il machine learning di Kaspersky aumenta la capacità di...Ott 02, 2024 0

Grazie al machine learning, il Global Research and Analysis... -

I vertici aziendali non sono del tutto pronti alle nuove...

I vertici aziendali non sono del tutto pronti alle nuove...Set 30, 2024 0

Il 2024 è l’anno delle nuove normative di sicurezza:... -

Più della meta delle aziende geo-distribuite ha problemi...

Più della meta delle aziende geo-distribuite ha problemi...Mag 21, 2024 0

Una delle sfide principali delle aziende distribuite sul...

Post recenti

-

Falso repository OpenAI su Hugging Face distribuisce

Falso repository OpenAI su Hugging Face distribuisceMag 11, 2026 0

La corsa all’AI sta creando nuove superfici di attacco... -

Ecco il GitHub per fare di Claude un operatore OSINT...

Ecco il GitHub per fare di Claude un operatore OSINT...Mag 08, 2026 0

L’intelligenza artificiale sta, ovviamente e... -

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Quasar Linux RAT: malware che punta alla supply chain...

Quasar Linux RAT: malware che punta alla supply chain...Mag 06, 2026 0

Un nuovo malware Linux altamente sofisticato sta attirando... -

CISA avvisa: Copy Fail sfruttata per root sui sistemi Linux

CISA avvisa: Copy Fail sfruttata per root sui sistemi LinuxMag 04, 2026 0

CISA ha inserito Copy Fail tra le vulnerabilità sfruttate...