Aggiornamenti recenti Maggio 8th, 2026 12:03 PM

News Recenti

- Transparency Center Initiative di Kaspersky Lab: cosa significa per l’Italia

- Ecco il GitHub per fare di Claude un operatore OSINT avanzato

- Un dipendente su otto considera accettabile vendere le credenziali

- Quasar Linux RAT: malware che punta alla supply chain software

- CISA avvisa: Copy Fail sfruttata per root sui sistemi Linux

- Mini Shai-Hulud: la supply chain SAP colpita da un simil-worm

IA e sicurezza: lo spettro della prompt injection

Set 04, 2023 Marina Londei Approfondimenti, Attacchi, Hacking, In evidenza, Minacce, RSS, Vulnerabilità 0

I modelli di intelligenza artificiale migliorano a batter d’occhio, ma la comprensione ancora limitata di essi potrebbe esporre le aziende a gravi problemi di sicurezza. Secondo il National Cyber Security Centre (NCSC), agenzia per la cybersicurezza del Regno Unito, ci sono ancora molti aspetti degli LLM che ci rimangono oscuri, in particolare quelli legati ai rischi e alle vulnerabilità intrinseci dei modelli.

L’NCSC mette in guardia dai pericoli associati all’uso di tecnologie che, guardando alla realtà dei fatti, sono ancora in una fase iniziale di sviluppo caratterizzata dalla necessità di comprendere rischi e benefici, valutando quali pesano di più. La maggior parte delle aziende, intanto, ha già integrato questi strumenti nei propri processi, elogiandoli dopo aver riscontrato un significativo aumento della produttività e dell’efficienza.

Ma a che punto siamo con la cybersecurity nell’ambito dell’intelligenza artificiale? Sfortunatamente i progressi non sono ancora soddisfacenti. Oltre ad automatizzare gli attacchi, rendendo il cybercrimine un’attività accessibile a tutti, i sistemi di IA nascondono dei pericoli per i quali non esistono ancora contromisure efficaci.

Pixabay

Secondo l’NCSC, il rischio principale dei modelli è legato alla prompt injection, una tecnica di attacco che usa degli input creati ad hoc per indurre il chatbot a fornire uno specifico risultato o a eseguire determinate azioni.

L’NCSC condivide un esempio che spiega bene la pericolosità di questo tipo di attacco: consideriamo un chatbot di IA di un istituto bancario in grado di assistere i clienti non solo rispondendo alle loro domande, ma anche eseguendo operazioni sulle loro finanze.

Sfruttando il fatto che un modello di IA non riesce a distinguere un’istruzione dai dati condivisi per completarla, un attaccante potrebbe inviare alla vittima una richiesta di transazione (per esempio impersonando un sito di shopping online) nella quale è nascosto un prompt che, analizzato dal modello, indica al chatbot di trasferire il denaro verso il conto dell’attaccante.

La prompt injection è un tipo di attacco nuovo e ancora poco approfondito che necessita di tecniche specifiche per essere contrastato. Gli esperti di sicurezza sono al lavoro per individuare possibili mitigazioni, ma per il momento non ci sono metodi infallibili.

Credits: ramirezoom- Depositphotos

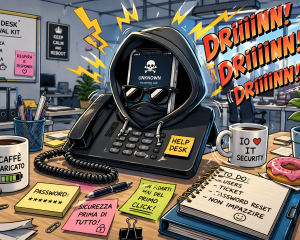

Come proteggersi, allora? Per il momento la soluzione migliore è limitare le operazioni che un chatbot può eseguire in modo che, anche nello scenario peggiore, non si verifichino gravi conseguenze sulla sicurezza dei consumatori. Per quanto le nuove tecnologie siano entusiasmanti, ci sono ancora troppi pericoli irrisolti per adottarle in maniera diffusa e sicura.

Articoli correlati

-

Ecco il GitHub per fare di Claude un...

Ecco il GitHub per fare di Claude un...Mag 08, 2026 0

-

Un dipendente su otto considera...

Un dipendente su otto considera...Mag 07, 2026 0

-

Reset password: una misura di sicurezza...

Reset password: una misura di sicurezza...Apr 23, 2026 0

-

APT28 colpisce i router per dirottare...

APT28 colpisce i router per dirottare...Apr 07, 2026 0

Altro in questa categoria

-

Quasar Linux RAT: malware che punta...

Quasar Linux RAT: malware che punta...Mag 06, 2026 0

-

CISA avvisa: Copy Fail sfruttata per...

CISA avvisa: Copy Fail sfruttata per...Mag 04, 2026 0

-

Mini Shai-Hulud: la supply chain SAP...

Mini Shai-Hulud: la supply chain SAP...Apr 30, 2026 0

-

Honeypot intelligenti: come gli agenti...

Honeypot intelligenti: come gli agenti...Apr 29, 2026 0

Last Week Security IT

Malware distruttivi ancora in auge

Approfondimenti

-

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Honeypot intelligenti: come gli agenti AI ingannano gli...

Honeypot intelligenti: come gli agenti AI ingannano gli...Apr 29, 2026 0

Stanno arrivando, ma non nascono già pronti. Stiamo... -

I dati sono recuperabili (troppo) facilmente dalle auto...

I dati sono recuperabili (troppo) facilmente dalle auto...Apr 28, 2026 0

Come sappiamo, le auto moderne sono sempre più simili a... -

Reset password: una misura di sicurezza che diventa

Reset password: una misura di sicurezza che diventaApr 23, 2026 0

Vi ricordate il vecchio adagio “cambia la password almeno... -

Recovery scam: quando la truffa colpisce due volte

Recovery scam: quando la truffa colpisce due volteApr 16, 2026 0

Nel panorama delle minacce informatiche, esiste una...

Minacce recenti

Google API Keys: le chiavi pubbliche diventano credenziali sensibili

Lummastealer risorge dalle ceneri: ancora una volta lo stop è momentaneo

ZeroDayRAT: La Nuova Minaccia per Android e iOS

Off topic

-

L’IA generativa unifica le interfacce di gestione e...

L’IA generativa unifica le interfacce di gestione e...Gen 29, 2025 0

Con l’avvento dell’IA generativa... -

Cyberinsurance: misurare il rischio umano può...

Cyberinsurance: misurare il rischio umano può...Ott 09, 2024 0

Negli ultimi anni sempre più aziende stanno sottoscrivendo... -

Il machine learning di Kaspersky aumenta la capacità di...

Il machine learning di Kaspersky aumenta la capacità di...Ott 02, 2024 0

Grazie al machine learning, il Global Research and Analysis... -

I vertici aziendali non sono del tutto pronti alle nuove...

I vertici aziendali non sono del tutto pronti alle nuove...Set 30, 2024 0

Il 2024 è l’anno delle nuove normative di sicurezza:... -

Più della meta delle aziende geo-distribuite ha problemi...

Più della meta delle aziende geo-distribuite ha problemi...Mag 21, 2024 0

Una delle sfide principali delle aziende distribuite sul...

Post recenti

-

Ecco il GitHub per fare di Claude un operatore OSINT...

Ecco il GitHub per fare di Claude un operatore OSINT...Mag 08, 2026 0

L’intelligenza artificiale sta, ovviamente e... -

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Quasar Linux RAT: malware che punta alla supply chain...

Quasar Linux RAT: malware che punta alla supply chain...Mag 06, 2026 0

Un nuovo malware Linux altamente sofisticato sta attirando... -

CISA avvisa: Copy Fail sfruttata per root sui sistemi Linux

CISA avvisa: Copy Fail sfruttata per root sui sistemi LinuxMag 04, 2026 0

CISA ha inserito Copy Fail tra le vulnerabilità sfruttate... -

Mini Shai-Hulud: la supply chain SAP colpita da un...

Mini Shai-Hulud: la supply chain SAP colpita da un...Apr 30, 2026 0

La compromissione della supply chain software continua a...