Aggiornamenti recenti Maggio 11th, 2026 3:00 PM

News Recenti

- Transparency Center Initiative di Kaspersky Lab: cosa significa per l’Italia

- Falso repository OpenAI su Hugging Face distribuisce malware

- Ecco il GitHub per fare di Claude un operatore OSINT avanzato

- Un dipendente su otto considera accettabile vendere le credenziali

- Quasar Linux RAT: malware che punta alla supply chain software

- CISA avvisa: Copy Fail sfruttata per root sui sistemi Linux

Falso repository OpenAI su Hugging Face distribuisce malware

Mag 11, 2026 Redazione Attacchi, In evidenza, News, RSS 0

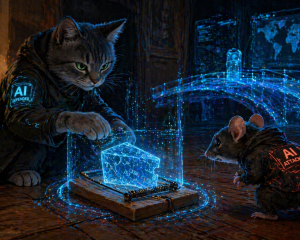

La corsa all’AI sta creando nuove superfici di attacco e i cybercriminali stanno iniziando a sfruttarle con tecniche sempre più sofisticate. L’ultimo caso arriva dal mondo dei modelli open source e delle piattaforme collaborative dedicate all’intelligenza artificiale: un repository malevolo pubblicato su Hugging Face è riuscito a spacciarsi per un progetto ufficiale di OpenAI, raggiungendo rapidamente la vetta dei contenuti più popolari prima di essere rimosso.

Secondo quanto riportato da The Hacker News, il repository fraudolento imitava il progetto “privacy-filter” di OpenAI, copiandone descrizione e struttura per convincere sviluppatori e ricercatori a scaricare codice malevolo. L’obiettivo finale, come avviene sempre più spesso negli attacchi alla catena del software, era il furto di credenziali, cookie di sessione e dati sensibili dai browser Windows delle vittime.

L’attacco alla fiducia dell’ecosistema AI open source

La vicenda mostra come l’ecosistema AI stia vivendo una dinamica molto simile a quella già osservata negli anni nel mondo dei package npm, PyPI e GitHub. I criminali non devono necessariamente violare infrastrutture complesse: spesso basta sfruttare la fiducia implicita che sviluppatori e ricercatori ripongono nei repository pubblici.

Nel caso specifico, gli attaccanti hanno creato un progetto chiamato “Open-OSS/privacy-filter”, estremamente simile a quello reale pubblicato da OpenAI. Il repository riprendeva testi, descrizioni e struttura del progetto originale, rendendo difficile per molti utenti distinguere il repository legittimo da quello malevolo.

Secondo le analisi, il repository sarebbe riuscito a ottenere centinaia di migliaia di download prima della rimozione, sfruttando anche account fake e meccanismi di trending della piattaforma.

Come funzionava il malware nascosto nel repository

Il cuore dell’attacco era un file Python apparentemente innocuo chiamato “loader.py”. Dietro codice, che simulava normali funzioni AI, il file nascondeva una catena di infezione progettata per scaricare ed eseguire un infostealer sviluppato in Rust.

L’analisi tecnica evidenzia diversi elementi tipici delle moderne campagne malware. Uno dei primi passaggi consisteva nella disattivazione della verifica SSL, scelta che permetteva al codice di contattare server remoti senza controlli rigorosi sui certificati.

Successivamente il malware decodificava dinamicamente URL in Base64 e recuperava payload esterni contenenti comandi PowerShell eseguiti in background. Da lì veniva scaricato il componente finale dell’attacco: un infostealer compilato in Rust, linguaggio sempre più utilizzato nel cybercrime moderno perché più difficile da analizzare e facilmente utilizzabile su più piattaforme.

Una volta attivo, il malware cercava informazioni nei browser Chromium e Gecko-based, inclusi Chrome, Edge e Firefox. Nel mirino finivano password salvate, cookie, token di autenticazione e sessioni attive, informazioni particolarmente preziose per compromettere account cloud, piattaforme AI e servizi enterprise.

Il nuovo problema: modelli AI come vettore di supply chain attack

Il caso conferma una tendenza che molti ricercatori stanno osservando da mesi: le piattaforme AI stanno diventando un nuovo terreno di supply chain attack.

Hugging Face, come GitHub nel mondo software tradizionale, si basa su un modello estremamente aperto. Chiunque può pubblicare modelli, dataset e codice. Questa apertura accelera l’innovazione, ma crea anche un ambiente ideale per campagne di impersonificazione, typosquatting e distribuzione malware.

Il problema è amplificato dalla velocità con cui le aziende stanno adottando strumenti AI. Molti sviluppatori scaricano modelli e repository senza effettuare verifiche approfondite sull’autore, sulle dipendenze o sul codice eseguito localmente. Il risultato è che la fiducia nell’ecosistema open source AI rischia di diventare un nuovo punto debole della sicurezza enterprise. Non a caso, negli ultimi mesi si sono moltiplicati gli incidenti legati a modelli malevoli, package compromessi e strumenti AI distribuiti con payload nascosti.

Perché gli infostealer sono così pericolosi nel mondo AI

Gli infostealer rappresentano oggi una delle categorie malware più redditizie per i cybercriminali. Nel contesto AI, il loro valore cresce ulteriormente perché gli sviluppatori tendono ad avere accesso privilegiato a infrastrutture cloud, repository di codice e piattaforme di training. Un singolo account compromesso può consentire attacchi a catena contro pipeline CI/CD, modelli proprietari, dataset sensibili e infrastrutture cloud aziendali. Cookie di sessione e token API possono inoltre permettere agli attaccanti di bypassare MFA e altri controlli tradizionali.

In pratica, il furto di credenziali da un laptop di sviluppo può diventare il punto di partenza per compromissioni molto più ampie, incluse intrusioni nella supply chain software o manipolazioni di modelli AI distribuiti pubblicamente.

- AI security, browser cookie, credential theft, cybercrime, cybersecurity, hugging face, infostealer Rust, loader.py, malware AI, malware Windows, openai, repository malevoli, supply chain attack

Articoli correlati

-

Ecco il GitHub per fare di Claude un...

Ecco il GitHub per fare di Claude un...Mag 08, 2026 0

-

Un dipendente su otto considera...

Un dipendente su otto considera...Mag 07, 2026 0

-

Quasar Linux RAT: malware che punta...

Quasar Linux RAT: malware che punta...Mag 06, 2026 0

-

Honeypot intelligenti: come gli agenti...

Honeypot intelligenti: come gli agenti...Apr 29, 2026 0

Altro in questa categoria

-

CISA avvisa: Copy Fail sfruttata per...

CISA avvisa: Copy Fail sfruttata per...Mag 04, 2026 0

-

Mini Shai-Hulud: la supply chain SAP...

Mini Shai-Hulud: la supply chain SAP...Apr 30, 2026 0

-

I dati sono recuperabili (troppo)...

I dati sono recuperabili (troppo)...Apr 28, 2026 0

-

Kyber annuncia il ransomware...

Kyber annuncia il ransomware...Apr 22, 2026 0

Last Week Security IT

Malware distruttivi ancora in auge

Approfondimenti

-

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Honeypot intelligenti: come gli agenti AI ingannano gli...

Honeypot intelligenti: come gli agenti AI ingannano gli...Apr 29, 2026 0

Stanno arrivando, ma non nascono già pronti. Stiamo... -

I dati sono recuperabili (troppo) facilmente dalle auto...

I dati sono recuperabili (troppo) facilmente dalle auto...Apr 28, 2026 0

Come sappiamo, le auto moderne sono sempre più simili a... -

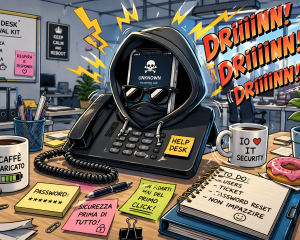

Reset password: una misura di sicurezza che diventa

Reset password: una misura di sicurezza che diventaApr 23, 2026 0

Vi ricordate il vecchio adagio “cambia la password almeno... -

Recovery scam: quando la truffa colpisce due volte

Recovery scam: quando la truffa colpisce due volteApr 16, 2026 0

Nel panorama delle minacce informatiche, esiste una...

Minacce recenti

Google API Keys: le chiavi pubbliche diventano credenziali sensibili

Lummastealer risorge dalle ceneri: ancora una volta lo stop è momentaneo

ZeroDayRAT: La Nuova Minaccia per Android e iOS

Off topic

-

L’IA generativa unifica le interfacce di gestione e...

L’IA generativa unifica le interfacce di gestione e...Gen 29, 2025 0

Con l’avvento dell’IA generativa... -

Cyberinsurance: misurare il rischio umano può...

Cyberinsurance: misurare il rischio umano può...Ott 09, 2024 0

Negli ultimi anni sempre più aziende stanno sottoscrivendo... -

Il machine learning di Kaspersky aumenta la capacità di...

Il machine learning di Kaspersky aumenta la capacità di...Ott 02, 2024 0

Grazie al machine learning, il Global Research and Analysis... -

I vertici aziendali non sono del tutto pronti alle nuove...

I vertici aziendali non sono del tutto pronti alle nuove...Set 30, 2024 0

Il 2024 è l’anno delle nuove normative di sicurezza:... -

Più della meta delle aziende geo-distribuite ha problemi...

Più della meta delle aziende geo-distribuite ha problemi...Mag 21, 2024 0

Una delle sfide principali delle aziende distribuite sul...

Post recenti

-

Falso repository OpenAI su Hugging Face distribuisce

Falso repository OpenAI su Hugging Face distribuisceMag 11, 2026 0

La corsa all’AI sta creando nuove superfici di attacco... -

Ecco il GitHub per fare di Claude un operatore OSINT...

Ecco il GitHub per fare di Claude un operatore OSINT...Mag 08, 2026 0

L’intelligenza artificiale sta, ovviamente e... -

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Quasar Linux RAT: malware che punta alla supply chain...

Quasar Linux RAT: malware che punta alla supply chain...Mag 06, 2026 0

Un nuovo malware Linux altamente sofisticato sta attirando... -

CISA avvisa: Copy Fail sfruttata per root sui sistemi Linux

CISA avvisa: Copy Fail sfruttata per root sui sistemi LinuxMag 04, 2026 0

CISA ha inserito Copy Fail tra le vulnerabilità sfruttate...