Aggiornamenti recenti Giugno 30th, 2025 12:22 PM

News Recenti

- Transparency Center Initiative di Kaspersky Lab: cosa significa per l’Italia

- Una vulnerabilità di Open VSX Registry mette in pericolo milioni di sviluppatori

- Le stampanti multifunzione sono piene di bug! Uno espone la password di admin e Brother fa il record

- L’Iran lancia un attacco di spear-phishing contro obiettivi israeliani

- Windows 10: ancora un anno di aggiornamenti (quasi) gratis

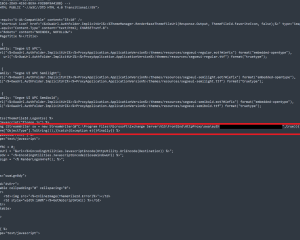

- Attacchi silenziosi ai server Exchange: keylogger in JavaScript rubano credenziali dalle pagine di login

Prompt engineering per criminali informatici

Gen 20, 2023 Dario Orlandi News, Opinioni, RSS, Scenario, Social engineering, Tecnologia 0

L’accesso a modelli di intelligenza artificiale capaci di generare testi verosimili in pochi secondi rappresenta un punto di svolta nella storia umana.

Ma questa tecnologia è anche una nuova arma che si aggiunge all’arsenale della criminalità informatica, come ha dimostrato la ricerca Creatively malicious prompt engineering, pubblicata da WithSecure (precedentemente nota come F-Secure Business).

La ricerca descrive una serie di esperimenti condotti utilizzando modelli di linguaggio GPT-3 per generare testo dannoso attraverso il prompt engineering.

Gli esperimenti hanno valutato come le modifiche negli input influiscano sull’output del testo sintetico e hanno riguardato phishing, molestie, truffe, appropriazione di uno stile scritto, creazione di opinioni divisive e notizie false.

L’obiettivo è identificare come la generazione del linguaggio AI possa essere utilizzata in modo improprio, per migliorare la sicurezza dei modelli linguistici futuri.

Umano oppure no?

Andy Patel, il ricercatore di WithSecure Intelligence che ha guidato la ricerca, ha dichiarato: “Il fatto che chiunque abbia una connessione Internet possa ora accedere a potenti modelli linguistici di grandi dimensioni ha una conseguenza molto pratica: ora è ragionevole supporre che qualsiasi nuova comunicazione ricevuta possa essere stata scritta con l’aiuto di un sistema automatico”.

Andy Patel, ricercatore di WithSecure

Le risposte fornite dai modelli GPT-3 hanno portato i ricercatori a individuare alcune conclusioni riguardo all’uso di queste tecnologie. WithSecure prevede innanzi tutto un aumento nello sviluppo dell’ingegneria dei prompt e nella creazione di prompt dannosi, con una maggiore abilità degli avversari nell’utilizzare modelli linguistici di grandi dimensioni in modi imprevedibili.

Per contro, i gestori delle piattaforme di comunicazione avranno più difficoltà nell’identificare contenuti offensivi e i criminali informatici potranno rendere più efficaci le loro comunicazioni mirate in un attacco.

“Abbiamo iniziato questa ricerca prima che ChatGPT rendesse la tecnologia GPT-3 disponibile a tutti. Questa novità ha aumentato i nostri sforzi e l’urgenza dell’analisi. Perché, in una certa misura, ora siamo tutti Blade Runner, che cercano di capire se l’intelligenza con cui abbiamo a che fare è reale o artificiale”, ha concluso Patel.

- Fake news, Intelligenza artificiale, Phishing, prompt engineering, ricerca, Spear Phishing, WithSecure

Articoli correlati

-

L’Iran lancia un attacco di...

L’Iran lancia un attacco di...Giu 26, 2025 0

-

Prompt injection indiretta, Google...

Prompt injection indiretta, Google...Giu 24, 2025 0

-

Cybercriminali russi aggirano...

Cybercriminali russi aggirano...Giu 23, 2025 0

-

Le aziende italiane prevedono un...

Le aziende italiane prevedono un...Giu 09, 2025 0

Altro in questa categoria

-

Una vulnerabilità di Open VSX Registry...

Una vulnerabilità di Open VSX Registry...Giu 30, 2025 0

-

Le stampanti multifunzione sono piene...

Le stampanti multifunzione sono piene...Giu 27, 2025 0

-

Windows 10: ancora un anno di...

Windows 10: ancora un anno di...Giu 25, 2025 0

-

Attacchi silenziosi ai server Exchange:...

Attacchi silenziosi ai server Exchange:...Giu 24, 2025 0

Last Week Security IT

Malware distruttivi ancora in auge

Approfondimenti

-

Le aziende italiane prevedono un aumento degli investimenti...

Le aziende italiane prevedono un aumento degli investimenti...Giu 09, 2025 0

La cybersecurity sta acquisendo sempre più importanza tra... -

Sophos Annual Threat Report: i malware e gli strumenti più...

Sophos Annual Threat Report: i malware e gli strumenti più...Mag 30, 2025 0

Nel 2024, le piccole e medie imprese, spesso considerate il... -

Down di MATLAB: MathWorks conferma l’attacco...

Down di MATLAB: MathWorks conferma l’attacco...Mag 27, 2025 0

MATLAB ha smesso di funzionare per quasi una settimana e... -

Acronis: l’italia traina la crescita MSP

Acronis: l’italia traina la crescita MSPMag 27, 2025 0

Nel corso del “TRU Security Day 2025” di... -

Akamai individua “BadSuccessor” per...

Akamai individua “BadSuccessor” per...Mag 26, 2025 0

I ricercatori di Akamai hanno individuato di recente...

Minacce recenti

L’Iran lancia un attacco di spear-phishing contro obiettivi israeliani

Prompt injection indiretta, Google migliora la sua strategia di sicurezza a più livelli per l’IA

Cybercriminali russi aggirano l’MFA di Gmail con una campagna di phishing sofisticata

Off topic

-

L’IA generativa unifica le interfacce di gestione e...

L’IA generativa unifica le interfacce di gestione e...Gen 29, 2025 0

Con l’avvento dell’IA generativa... -

Cyberinsurance: misurare il rischio umano può...

Cyberinsurance: misurare il rischio umano può...Ott 09, 2024 0

Negli ultimi anni sempre più aziende stanno sottoscrivendo... -

Il machine learning di Kaspersky aumenta la capacità di...

Il machine learning di Kaspersky aumenta la capacità di...Ott 02, 2024 0

Grazie al machine learning, il Global Research and Analysis... -

I vertici aziendali non sono del tutto pronti alle nuove...

I vertici aziendali non sono del tutto pronti alle nuove...Set 30, 2024 0

Il 2024 è l’anno delle nuove normative di sicurezza:... -

Più della meta delle aziende geo-distribuite ha problemi...

Più della meta delle aziende geo-distribuite ha problemi...Mag 21, 2024 0

Una delle sfide principali delle aziende distribuite sul...

Post recenti

-

Una vulnerabilità di Open VSX Registry mette in pericolo...

Una vulnerabilità di Open VSX Registry mette in pericolo...Giu 30, 2025 0

I ricercatori di Koi Security hanno individuato una... -

Le stampanti multifunzione sono piene di bug! Uno espone la...

Le stampanti multifunzione sono piene di bug! Uno espone la...Giu 27, 2025 0

Durante un processo di analisi di vulnerabilità zero-day,... -

L’Iran lancia un attacco di spear-phishing contro...

L’Iran lancia un attacco di spear-phishing contro...Giu 26, 2025 0

I ricercatori di Check Point Research hanno individuato una... -

Windows 10: ancora un anno di aggiornamenti (quasi) gratis

Windows 10: ancora un anno di aggiornamenti (quasi) gratisGiu 25, 2025 0

Il 14 ottobre il supporto tecnico e di sicurezza per... -

Attacchi silenziosi ai server Exchange: keylogger in...

Attacchi silenziosi ai server Exchange: keylogger in...Giu 24, 2025 0

Una nuova campagna mirata ai server Microsoft Exchange...