Aggiornamenti recenti Maggio 14th, 2026 3:40 PM

News Recenti

- Transparency Center Initiative di Kaspersky Lab: cosa significa per l’Italia

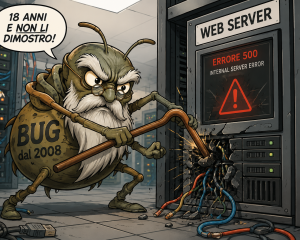

- NGINX Rift, rischio RCE per una falla rimasta nascosta 18 anni

- Falso repository OpenAI su Hugging Face distribuisce malware

- Ecco il GitHub per fare di Claude un operatore OSINT avanzato

- Un dipendente su otto considera accettabile vendere le credenziali

- Quasar Linux RAT: malware che punta alla supply chain software

Settore sanitario, gli operatori caricano dati sensibili in cloud e nelle app di IA

Mag 12, 2025 Marina Londei Approfondimenti, Gestione dati, In evidenza, Minacce, Minacce, News, RSS 0

Stando all’ultimo report sulle minacce al settore sanitario di Netskope Threat Labs, i lavoratori del settore caricano regolarmente dati sensibili su siti web e piattaforme cloud non approvati.

Sono in particolare le applicazioni di intelligenza artificiale quelle coinvolte in queste violazioni, prime fra tutte ChatGPT e Gemini. Secondo l’analisi di Netskope, l’81% delle violazioni delle policy sui dati nelle organizzazioni sanitarie nell’ultimo anno ha riguardato dati sanitari regolamentati, ovvero protetti da normative locali, nazionali e internazionali, contenenti informazioni mediche e cliniche sensibili.

Password, chiavi di accesso, codice sorgente e proprietà intellettuale rappresentano invece il restante 19% delle violazioni. La maggior parte di esse è stata provocata dalla condivisione dei dati su account personali di OneDrive o Google Drive.

Violazioni di dati sensibili nel settore sanitario: il pericolo dell’IA

I tool di intelligenza artificiale sono diventati molto diffusi anche nel settore sanitario: secondo il report di Netskope, l’88% delle organizzazioni integra applicazioni di IA in cloud. La quasi totalità delle realtà che sfruttano questi strumenti usa i dati degli utenti per l’addestramento.

Anche se l’IA porta molti benefici al settore sanitario, la condivisione di dati sensibili aumenta il rischio di violazioni. Se si considera che il 44% degli incidenti registrati coinvolge dati regolamentati, è facile comprendere l’impatto dei comportamenti errati degli operatori. Il report di Netskope evidenzia a tal proposito che più di due utenti di genAI su tre nel settore sanitario inviano dati sensibili ai propri account personali durante l’orario di lavoro, ostacolando la visibilità dei team di sicurezza.

“Le applicazioni di intelligenza artificiale generativa offrono soluzioni innovative, ma introducono anche nuovi vettori per potenziali violazioni dei dati, soprattutto in ambienti ad alta pressione e criticità come quello sanitario, dove il personale e i professionisti devono spesso operare con rapidità e agilità. Le organizzazioni sanitarie devono bilanciare i benefici della genAI con l’adozione di misure di sicurezza e protezione dei dati per mitigare tali rischi” ha commentato Gianpietro Cutolo, Cloud Threat Researcher presso Netskope Threat Labs.

Mitigare il rischio di violazione

Per ridurre il rischio di violazioni, soprattutto quelle legate alla condivisione di dati sensibili su strumenti di IA, le organizzazioni del settore sanitario dovrebbero innanzitutto implementare politiche di DLP (Data Loss Prevention – Prevenzione della perdita di dati) per monitorare l’accesso alle applicazioni di GenAI e definire il tipo di dati che può essere condiviso con esse. Oggi la percentuale di realtà sanitarie che hanno adottato politiche DLP è salita al 54% dal 31% dell’anno scorso.

È essenziale inoltre implementare applicazioni di IA generativa approvate dall’organizzazione, in modo che i team di sicurezza abbiano un maggior controllo su di esse e si riduca il rischio di “shadow AI”. Infine, occorre affidarsi a strumenti di formazione in tempo reale per gli utenti che siano in grado anche di avvisarli quando stanno compiendo azioni rischiose.

“Nel settore sanitario, la rapida adozione delle applicazioni di intelligenza artificiale generativa e l’uso crescente delle piattaforme cloud hanno reso ancora più urgente la protezione dei dati sanitari regolamentati. Man mano che la genAI viene integrata nei flussi di lavoro clinici e operativi, le organizzazioni stanno accelerando l’implementazione di controlli come le politiche DLP e il blocco delle applicazioni per ridurre i rischi. Le organizzazioni sanitarie stanno facendo progressi, ma sarà fondamentale mantenere l’attenzione su soluzioni sicure e approvate a livello aziendale, per garantire che i dati restino protetti in questo scenario in continua evoluzione” ha concluso Cutolo.

Articoli correlati

-

False estensioni AI su Chrome: rubano...

False estensioni AI su Chrome: rubano...Feb 13, 2026 0

-

OpenSSL ha fixato 12 vulnerabilità...

OpenSSL ha fixato 12 vulnerabilità...Gen 29, 2026 0

-

Il 64% delle app di terze parti accede...

Il 64% delle app di terze parti accede...Gen 16, 2026 0

-

Microsoft smantella RedVDS, rete...

Microsoft smantella RedVDS, rete...Gen 15, 2026 0

Altro in questa categoria

-

NGINX Rift, rischio RCE per una falla...

NGINX Rift, rischio RCE per una falla...Mag 14, 2026 0

-

Falso repository OpenAI su Hugging Face...

Falso repository OpenAI su Hugging Face...Mag 11, 2026 0

-

Ecco il GitHub per fare di Claude un...

Ecco il GitHub per fare di Claude un...Mag 08, 2026 0

-

Un dipendente su otto considera...

Un dipendente su otto considera...Mag 07, 2026 0

Last Week Security IT

Malware distruttivi ancora in auge

Approfondimenti

-

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Honeypot intelligenti: come gli agenti AI ingannano gli...

Honeypot intelligenti: come gli agenti AI ingannano gli...Apr 29, 2026 0

Stanno arrivando, ma non nascono già pronti. Stiamo... -

I dati sono recuperabili (troppo) facilmente dalle auto...

I dati sono recuperabili (troppo) facilmente dalle auto...Apr 28, 2026 0

Come sappiamo, le auto moderne sono sempre più simili a... -

Reset password: una misura di sicurezza che diventa

Reset password: una misura di sicurezza che diventaApr 23, 2026 0

Vi ricordate il vecchio adagio “cambia la password almeno... -

Recovery scam: quando la truffa colpisce due volte

Recovery scam: quando la truffa colpisce due volteApr 16, 2026 0

Nel panorama delle minacce informatiche, esiste una...

Minacce recenti

Google API Keys: le chiavi pubbliche diventano credenziali sensibili

Lummastealer risorge dalle ceneri: ancora una volta lo stop è momentaneo

ZeroDayRAT: La Nuova Minaccia per Android e iOS

Off topic

-

L’IA generativa unifica le interfacce di gestione e...

L’IA generativa unifica le interfacce di gestione e...Gen 29, 2025 0

Con l’avvento dell’IA generativa... -

Cyberinsurance: misurare il rischio umano può...

Cyberinsurance: misurare il rischio umano può...Ott 09, 2024 0

Negli ultimi anni sempre più aziende stanno sottoscrivendo... -

Il machine learning di Kaspersky aumenta la capacità di...

Il machine learning di Kaspersky aumenta la capacità di...Ott 02, 2024 0

Grazie al machine learning, il Global Research and Analysis... -

I vertici aziendali non sono del tutto pronti alle nuove...

I vertici aziendali non sono del tutto pronti alle nuove...Set 30, 2024 0

Il 2024 è l’anno delle nuove normative di sicurezza:... -

Più della meta delle aziende geo-distribuite ha problemi...

Più della meta delle aziende geo-distribuite ha problemi...Mag 21, 2024 0

Una delle sfide principali delle aziende distribuite sul...

Post recenti

-

NGINX Rift, rischio RCE per una falla rimasta nascosta 18...

NGINX Rift, rischio RCE per una falla rimasta nascosta 18...Mag 14, 2026 0

Una vulnerabilità critica rimasta nascosta per quasi due... -

Falso repository OpenAI su Hugging Face distribuisce

Falso repository OpenAI su Hugging Face distribuisceMag 11, 2026 0

La corsa all’AI sta creando nuove superfici di attacco... -

Ecco il GitHub per fare di Claude un operatore OSINT...

Ecco il GitHub per fare di Claude un operatore OSINT...Mag 08, 2026 0

L’intelligenza artificiale sta, ovviamente e... -

Un dipendente su otto considera accettabile vendere le...

Un dipendente su otto considera accettabile vendere le...Mag 07, 2026 0

Il problema del dipendente “infedele” è vecchio quanto... -

Quasar Linux RAT: malware che punta alla supply chain...

Quasar Linux RAT: malware che punta alla supply chain...Mag 06, 2026 0

Un nuovo malware Linux altamente sofisticato sta attirando...