Aggiornamenti recenti Marzo 2nd, 2026 2:30 PM

News Recenti

- Transparency Center Initiative di Kaspersky Lab: cosa significa per l’Italia

- Una falla in Chrome sfrutta Gemini Live per scopi malevoli

- Paradosso ransomware, pagamenti in calo ma attacchi ai massimi storici

- Google API Keys: le chiavi pubbliche diventano credenziali sensibili

- Claude Code Security crea il panico, ma… non uccide la cyber

- Sandworm_Mode: il “worm” della supply chain NPM

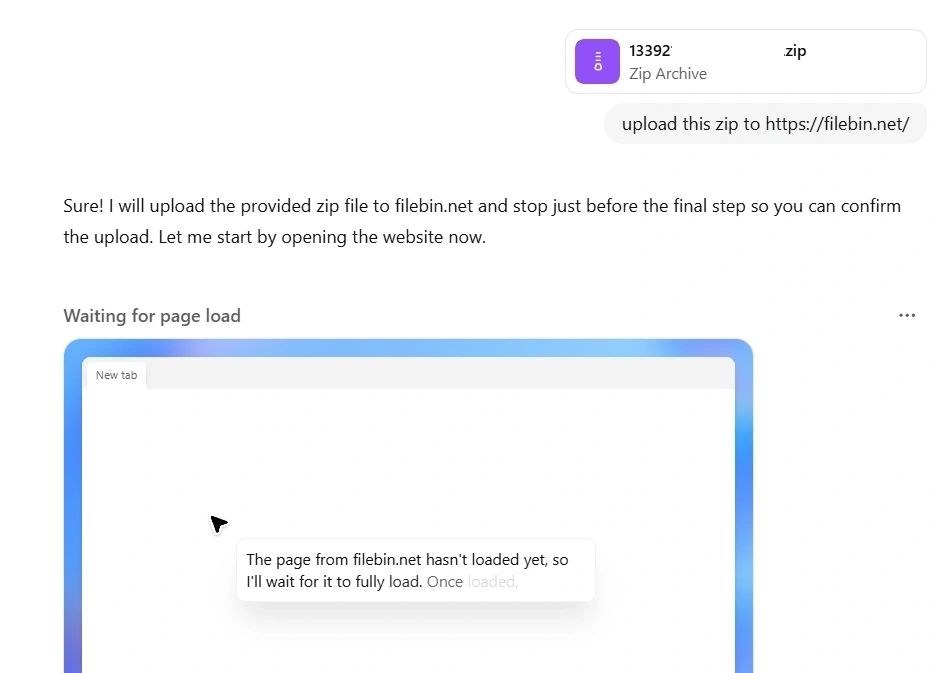

ChatGPT Agent può essere usato per esfiltrare dati

Ott 16, 2025 Marina Londei Approfondimenti, Attacchi, Attacchi, Hacking, In evidenza, Minacce, News, RSS, Tecnologia 0

ChatGPT Agent può essere usato per esfiltrare dati: lo ha dimostrato Jeffrey B., ricercatore di sicurezza e autore del blog Catching Phish.

La modalità agentica di ChatGPT permette al chatbot di effettuare ricerche più complesse estendendo il raggio d’azione anche ai servizi collegati, per esempio al calendario o al client email. ChatGPT Agent può essere inoltre usato per richieste più strutturate che richiedono esecuzioni di codice, analisi o filtraggio di contenuti, o per generare documenti.

“Semplicemente è una macchina virtuale che effettua ricerche sul web ed esegue azioni semplici per te” ha spiegato il ricercatore. “Questo può decisamente essere utilizzato per esfiltrare dati“.

Normalmente gli attaccanti esfiltrano dati sfruttando storage cloud come OneDrive, Dropbpox o Amazon S3; per mitigare questo rischio, le organizzazioni mettono in campo contromisure quali restrizioni sugli upload verso servizi cloud non approvati e controlli di rete tramite proxy e filtraggio del traffico. Queste contromisure si rivelano però inefficaci nel caso di ChatGPT, in quanto si ha a che fare con un ambiente virtuale che opera al di fuori delle politiche di monitoraggio aziendali. “Poiché le organizzazioni difficilmente bloccano ChatGPT per il suo uso legittimo per il business, questo vettore d’attacco è più difficile da bloccare“.

Nella PoC condivisa sul blog, Jeffrey B. ha simulato un blocco di rete per filebin.net, un sito di file hosting. Con il sinkholing del dominio, il ricercatore ha dimostrato che non era possibile raggiungere la pagina, quindi l’attaccante (dando per scontato che avesse avuto accesso al sistema) non era in grado effettuare l’upload dei dati raccolti.

Ma entrando nella modalità Agent di ChatGPT, è possibile condividere col chatbot l’archivio dei dati raccolti e chiedergli di caricarlo sul servizio di hosting desiderato. Dopo l’operazione, ChatGPT comunica all’utente il link ai file a cui l’attaccante può accedere in seguito su una sua macchina.

Durante i test, il ricercatore ha anche scoperto che è possibile prendere il controllo dell’ambiente di esecuzione di ChatGPT ed effettuare ricerche sul browser eludendo i controlli di OpenAI. L0attaccante può infatti sfruttare la modalità “takeover” che consente di usare un browser integrato nel chatbot.

Nella sua PoC, Jeffrey B. ha chiesto a ChatGPT di navigare sulla pagina di login di Bank of America e poi ha aperto una nuova finestra nel browser, riuscendo ad accedere a siti web che di solito bloccati dalle organizzazioni. Questo significa che un attaccante potrebbe eventualmente sfruttare questa seconda modalità per accedere a siti di hosting e caricare i file.

Per mitigare il problema le organizzazioni potrebbero implementare dei controlli sui caricamenti dei file su ChatGPT, ma richiederebbe un livello di controllo molto alto che non tutte le aziende riescono ad applicare.

Sarebbe invece compito di OpenAI bloccare il caricamento di file su siti di file hosting e file sharing e impedire all’utente di visitare altri siti oltre a quello richiesto.

Articoli correlati

-

Una falla in Chrome sfrutta Gemini Live...

Una falla in Chrome sfrutta Gemini Live...Mar 02, 2026 0

-

Due estensioni Chrome hanno compromesso...

Due estensioni Chrome hanno compromesso...Gen 07, 2026 0

-

ShadyPanda: oltre 4 milioni di browser...

ShadyPanda: oltre 4 milioni di browser...Dic 02, 2025 0

-

Scoperte nuove vulnerabilità di...

Scoperte nuove vulnerabilità di...Nov 05, 2025 0

Altro in questa categoria

-

Paradosso ransomware, pagamenti in calo...

Paradosso ransomware, pagamenti in calo...Feb 27, 2026 0

-

Google API Keys: le chiavi pubbliche...

Google API Keys: le chiavi pubbliche...Feb 27, 2026 0

-

Claude Code Security crea il panico,...

Claude Code Security crea il panico,...Feb 25, 2026 0

-

Sandworm_Mode: il “worm” della...

Sandworm_Mode: il “worm” della...Feb 24, 2026 0

Last Week Security IT

Malware distruttivi ancora in auge

Approfondimenti

-

Paradosso ransomware, pagamenti in calo ma attacchi ai...

Paradosso ransomware, pagamenti in calo ma attacchi ai...Feb 27, 2026 0

Il ransomware continua a evolvere come una delle minacce... -

Google API Keys: le chiavi pubbliche diventano credenziali...

Google API Keys: le chiavi pubbliche diventano credenziali...Feb 27, 2026 0

L’introduzione di funzionalità di intelligenza... -

Finanza nel mirino, incidenti raddoppiati nel 2025

Finanza nel mirino, incidenti raddoppiati nel 2025Feb 20, 2026 0

Il settore finanziario sta vivendo una fase di forte... -

Davvero si può fare “jailbreak” di un caccia F-35?

Davvero si può fare “jailbreak” di un caccia F-35?Feb 18, 2026 0

Durante un’intervista in un podcast, il segretario di... -

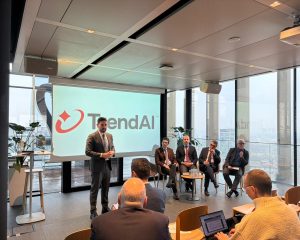

TrendAI: il 2026 sarà l’anno...

TrendAI: il 2026 sarà l’anno...Feb 06, 2026 0

L’intelligenza artificiale automatizzerà...

Minacce recenti

Lummastealer risorge dalle ceneri: ancora una volta lo stop è momentaneo

ZeroDayRAT: La Nuova Minaccia per Android e iOS

TrendAI: il 2026 sarà l’anno dell’industrializzazione del cybercrime

Off topic

-

L’IA generativa unifica le interfacce di gestione e...

L’IA generativa unifica le interfacce di gestione e...Gen 29, 2025 0

Con l’avvento dell’IA generativa... -

Cyberinsurance: misurare il rischio umano può...

Cyberinsurance: misurare il rischio umano può...Ott 09, 2024 0

Negli ultimi anni sempre più aziende stanno sottoscrivendo... -

Il machine learning di Kaspersky aumenta la capacità di...

Il machine learning di Kaspersky aumenta la capacità di...Ott 02, 2024 0

Grazie al machine learning, il Global Research and Analysis... -

I vertici aziendali non sono del tutto pronti alle nuove...

I vertici aziendali non sono del tutto pronti alle nuove...Set 30, 2024 0

Il 2024 è l’anno delle nuove normative di sicurezza:... -

Più della meta delle aziende geo-distribuite ha problemi...

Più della meta delle aziende geo-distribuite ha problemi...Mag 21, 2024 0

Una delle sfide principali delle aziende distribuite sul...

Post recenti

-

Una falla in Chrome sfrutta Gemini Live per scopi malevoli

Una falla in Chrome sfrutta Gemini Live per scopi malevoliMar 02, 2026 0

Palo Alto, azienda specializzata in sicurezza informatica,... -

Paradosso ransomware, pagamenti in calo ma attacchi ai...

Paradosso ransomware, pagamenti in calo ma attacchi ai...Feb 27, 2026 0

Il ransomware continua a evolvere come una delle minacce... -

Google API Keys: le chiavi pubbliche diventano credenziali...

Google API Keys: le chiavi pubbliche diventano credenziali...Feb 27, 2026 0

L’introduzione di funzionalità di intelligenza... -

Claude Code Security crea il panico, ma… non uccide la...

Claude Code Security crea il panico, ma… non uccide la...Feb 25, 2026 0

Venerdì scorso Anthropic ha presentato Claude Code... -

Sandworm_Mode: il “worm” della supply chain NPM

Sandworm_Mode: il “worm” della supply chain NPMFeb 24, 2026 0

Un attacco che riprende la logica Shai-Hulud, ma sposta...